При принятии важных решений нам часто приходится иметь дело со статистическими данными, смысл которых мы не совсем понимаем и поэтому полагаемся на мнение экспертов. В этой книге рассказывается, как распознавать случаи, когда предоставляемая нам информация оказывается неполной, и как следует поступать в таких ситуациях. Герд Гигеренцер показывает, как можно использовать простые правила, которые помогут нам избегать беспричинных страхов или надежд и принимать более грамотные и взвешенные решения. По теме см. также Даниэль Канеман. Думай медленно… решай быстро, Нассим Николас Талеб. Антихрупкость. Как извлечь выгоду из хаоса, Ричард Талер. Новая поведенческая экономика.

Герд Гигеренцер. Понимать риски. Как выбирать правильный курс. – М.: КоЛибри, Азбука-Аттикус, 2015. – 352 с.

Скачать конспект (краткое содержание) в формате Word или pdf

Купить цифровую книгу в ЛитРес, бумажную книгу в Ozon или Лабиринте

Часть I. Психология риска

Глава 1. Неужели люди настолько неразумны?

Рисковая грамотность – это базовое знание, необходимое для выживания в современном технологическом обществе. Когда я использую общий термин осознание риска, я имею в виду не только рисковую грамотность, но также и осмысление тех ситуаций, в которых не все риски известны и могут быть рассчитаны.

Когда вероятность риска выражается в процентах, всегда уточняйте: процент чего? Если относительный риск, выраженный в процентах, значителен, всегда спрашивайте: насколько возрастает абсолютный риск? Я объяснял различие между относительными и абсолютными рисками сотням журналистов, и многие из них перестали пугать публику и начали сообщать цифры абсолютных рисков – но лишь только для того, чтобы увидеть, как их редакторы нередко вновь обращаются к БОЛЬШИМ [относительным] числам. Мы не всегда способны остановить тех, кто любит поиграть на наших нервах, но мы можем научиться видеть их фокусы насквозь.

Террористы наносят удар дважды. Сначала они нападают на нас, используя физическую силу, а затем последствия террористической атаки оказывают воздействие на наш разум. Дело в том, что события, вероятность которых достаточно низка, но в которых внезапно гибнет много людей, – это так называемые «пугающие» риски. Они приводят в действие подсознательный психологический принцип: «В случае одновременной гибели многих людей возникает чувство страха и стремление избежать подобных ситуаций». В течение 12 месяцев после 11 сентября в общей сложности 1600 американцев лишились жизни на дорогах только потому, что приняли решение не рисковать, то есть не летать на самолетах.

Мы боимся редких аварий на атомных электростанциях, а не постоянного потока смертей, вызванных загрязнением воздуха электростанциями, работающими на каменном угле. Мы начинаем бояться пандемии свиного гриппа, услышав прогноз о возможных десятках тысяч смертельных исходов – который никогда не сбывается, – но при этом мало кто боится оказаться в числе тех десятков тысяч людей, которые действительно умирают каждый год от обычного гриппа.

Задумайтесь, сколько миль вы должны проехать прежде, чем риск вашей гибели в ДТП сравняется с риском совершения беспересадочного полета? Я задавал этот вопрос десяткам групп экспертов. Их ответы звучали примерно так: 1000 км, 10 000 км, трижды объехать вокруг Земли по экватору. Однако наиболее правильная оценка будет такой: 20 км. Если ваша машина благополучно доставит вас в аэропорт, то самая опасная часть вашего путешествия, вероятно, будет пройдена.

Действительно ли люди не способны осознавать риски? Я считаю, что способны.[1] Проблема состоит в том, что в нашей образовательной системе имеется удивительный пробел в области обучения рисковой грамотности. Мы учим наших детей «математике определенного» – геометрии и тригонометрии, – но не «математике неопределенного», оперирующей статистическими данными. И мы даем им знания биологии, а не психологии, которая выражает их страхи и желания.

Глава 2. Определенность – это иллюзия

Многие из нас требуют определенности от наших банкиров, врачей и политических лидеров. Однако ответы, полученные от них, по сути, создают лишь иллюзию определенности – веру в достоверность того, что на самом деле может быть неопределенным. Многие снисходительно посматривают на старомодных предсказателей судьбы. Однако, когда современные гадалки используют компьютерные алгоритмы вместо карт таро, мы относимся к их предсказаниям серьезно и соглашаемся платить за них. Но самое удивительное – это наша коллективная амнезия. Большинство из нас по-прежнему стремится узнать прогнозы поведения фондового рынка, даже несмотря на то, что они год за годом постоянно оказываются ошибочными.

Современные технологии добавили новые средства обеспечения кажущейся определенности – от генетических тестов и персонально разрабатываемых лекарств до способов оценки рисков в банковской деятельности. Когда привлекается технология, иллюзия достоверности усиливается.

Человеку необходима определенность, которая побуждает его сохранять свои убеждения, а не оспаривать их. Люди с высокой потребностью в определенности более склонны придерживаться стереотипов и менее склонны запоминать информацию, которая этим стереотипам противоречит. Неопределенность ставит их в тупик, и поэтому они стремятся планировать свою жизнь рационально. Само по себе желание все планировать и организовывать может оказаться частью проблемы, а не ее решением. Не случайно у евреев есть такая шутка: «Если хочешь рассмешить Бога, то расскажи ему о своих планах».

Для человека сильная потребность в определенности может оказаться опасной. Она мешает учиться смело смотреть в глаза неопределенностям, которые встречаются в нашей жизни на каждом шагу.

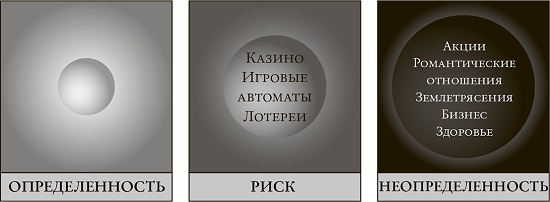

В начале XVII века вероятностная революция подарила человечеству навыки статистического мышления (см. Альфред Реньи. Письма о вероятности: письма Паскаля к Ферма), но эти навыки касались лишь самого простого аспекта неопределенности – области известного риска или просто риска (центральная часть рис. 1). Для принятия правильных решений в этом случае достаточно применять статистическое мышление и логику. Однако основную часть времени мы живем в изменяющемся мире, о котором мы знаем далеко не все и в котором мы сталкиваемся с неизвестными рисками или неопределенностью (рис. 1, справа).

Рис. 1. Определенность, риск и неопределенность

Но, даже когда расчеты не дают ясного ответа, мы обязаны принимать решения. К счастью, помимо математической вероятности, мы можем опереться на эвристики (в данном случае – типичные приемы образования суждений в условиях недостаточной или неопределенной информации).[2]

«Приручение» случайности привело к появлению математической вероятности. Я буду использовать термин известный риск или просто риск применительно к вероятностям, которые можно оценить эмпирически, в противоположность тем неопределенностям, которые невозможно рассчитать. Понятие вероятности имеет три характеристики: частоту, проявление на физическом уровне и степень доверия.

Частота. Во-первых, вероятность всегда связана с подсчетом и представляет собой относительные частоты. Их историческое происхождение ведет свой отсчет от составлявшихся в XVII веке таблиц смертности, на основании которых страхователи жизни рассчитывали вероятность смерти.

Проявление на физическом уровне. Во-вторых, вероятность имеет отношение к изготовлению тех или иных предметов. Например, если игральная кость с шестью гранями идеально симметрична, то вероятность выпадения числа шесть равна одной шестой. Вероятности, определяемые проявлением на физическом уровне, называются предрасположенностями. Такие риски известны, потому что люди не подсчитывают их, а закладывают в конструкцию изделия.

Степень доверия индивида, оценивающего неопределенность ситуации, может основываться на чем угодно, начиная от личного опыта и до личного впечатления. Но как количественно оценить эти интуитивные убеждения?[3]

Частота и проявление ограничивают вероятность ситуациями, подразумевающими, соответственно, наличие больших количеств данных или хорошо понятного проявления. Степень доверия, напротив, понятие более широкое, предполагающее, что концепция вероятности может применяться к любой проблеме. Однако при распространении вероятностного подхода на все ситуации возникает неоправданная уверенность в том, что один инструмент – расчет вероятности – оказывается достаточным для того, чтобы иметь дело со всеми типами неопределенности. Как следствие, другие важные инструменты, такие как простые эмпирические правила, остаются невостребованными.

Риск серьезной аварии на атомной электростанции может быть оценен по-разному: подсчетом количества подобных инцидентов в прошлом, на основе учета особенностей физической конструкции электростанции, с учетом степени доверия к этому проекту экспертов или посредством использования любой комбинации этих подходов. Полученные оценки могут сильно различаться между собой. И если подсчитать количество аварий просто, то предрасположенность данной конструкции электростанции к аварии определить довольно трудно. Все это приводит к широкому разбросу оценок, которые могут зависеть еще и от политических интересов оценщика и его спонсора. Именно поэтому всегда важно спрашивать, как в действительности рассчитывался риск ядерной катастрофы или риск любого другого события.

Применение простых практических правил, или эвристика, дают нам возможность быстро принимать достаточно хорошие решения, не затрачивая много времени на поиск информации. Каждое известное мне простое практическое правило может быть применено сознательно и бессознательно. Если оно используется бессознательно, то принятое с его помощью суждение называется интуитивным.

Было бы большой ошибкой считать, что разум – это обязательно осознание и размышление. Большинство отделов нашего мозга отвечают за подсознание, и мы были бы обречены на вымирание без хранящегося в нем огромного опыта. Наше общество часто противится признанию интуиции в качестве формы интеллекта. Среди ученых также есть те, кто относятся к интуиции с подозрением, и даже постулирует существование двух когнитивных систем: одна из которых – сознательная, логичная, расчетливая и рациональная, а другая – подсознательная, интуитивная, эвристическая и склонная к ошибкам. При этом каждая система работает по разным принципам.[4] Я считаю, что эвристика может оказаться более безопасной и более точной, чем расчет, и та же эвристика может лежать в основе как сознательных, так и бессознательных решений.

Разум – это не нечто абстрактное, наподобие коэффициента IQ, скорее он подобен имеющемуся у плотника неявному знанию об использовании наиболее подходящих инструментов.

Откуда взялись эти простые практические эмпирические правила? Некоторые из них были известны людям и животным в течение долгого времени. Например, когда собака гоняется за летающей тарелкой фрисби, она старается сохранять во время бега постоянный угол зрения, под которым она смотрит на объект преследования.

Эвристический подход оказывается успешным, потому что наш мозг прошел долгий путь эволюционного развития, в то время как у роботов и компьютеров он имеет ограниченное применение. Как ни странно, но большинство теорий рационального принятия решений в разных областях – от экономики до философии – по-прежнему основывается на том, что все риски являются известными. Значительная часть научно технической интеллигенции, специализирующаяся в области социальных наук, направляет свои усилия на совершенствование сложных методов логики и статистики. Но почти никто не занимается эвристическим мышлением, а когда все же обращается к нему, то главным образом для того, чтобы доказать, что эвристический подход приводит к ошибкам.

Можно говорить о двух видах проявления иллюзии определенности. Всякий раз, когда известные риски ошибочно принимаются за абсолютную определенность, возникает иллюзия нулевого риска (рис. 2, левая стрелка). Современные технологии, которые многие из нас считают непогрешимыми, такие как ВИЧ тесты, генетический анализ и различные виды томографии, предоставляют нам высокотехнологичные инструменты, благодаря которым и возникает иллюзия определенности. Иллюзия рассчитываемого риска – это совершенно иное проявление иллюзии определенности. В этом случае неопределенность ошибочно рассматривают как известные риски (рис. 2, правая стрелка).

Рис. 2. Два вида иллюзии определенности

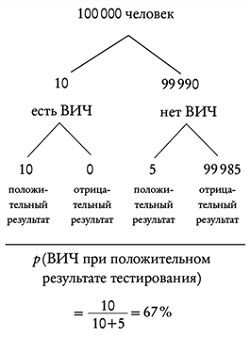

Иллюзия нулевого риска. ВИЧ тестирование широко распространено, но, что на самом деле означает положительный результат тестирования? Предположим, что показатель возможной ошибки равен 5/100 000 (рис. 3). Допустим, 100 тыс. женщин прошли тестирование на ВИЧ инфекцию. Статистика показывает, что примерно 10 из них действительно оказываются инфицированными (что обусловлено распространенностью заболевания) и что тест выявляет этих больных с высокой надежностью. Из большинства неинфицированных женщин еще пять будут иметь положительный результат тестирования. То есть к 10 правильным результатам тестирования добавляется пять неправильных. Таким образом, мы ожидаем, что 15 женщин получат положительный результат, но только 10 из них будут на самом деле инфицированы. В результате шансы, что человек действительно инфицирована, составят два к одному, что далеко от абсолютной достоверности.

Рис. 3. Пример иллюзии нулевого риска. Зависимость вероятности ситуации, когда пациент, получивший положительный результат ВИЧ тестирования, действительно инфицирован, от распространенности заболевания и доли ложноположительных результатов

Иллюзия индюка.

Эта история рассказана писателем Нассимом Талебом (см. Нассим Талеб. Черный лебедь. Под знаком непредсказуемости; хотя Талеб заимствовал идею у Бертрана Рассела, см. Человеческое познание, его сферы и границы). Представьте, что вы – индюк. В первый день вашей жизни к вам пришел человек. Вы испугались, так как думали, что он убьет вас, но человек был добр и накормил вас. На следующий день вы снова увидели, что этот человек направляется к вам. Покормит ли он вас сегодня? Используя теорию вероятности, вы можете рассчитать вероятность такого события. Правило, разработанное великим математиком Пьером Симоном Лапласом, дает ответ на этот вопрос (см. Пьер Симон Лаплас. Опыт философии теории вероятностей): вероятность того, что какое-то событие произойдет снова, если оно также происходило до этого n раз, = (n + 1)/ (n + 2).

На сотый день вы можете быть почти абсолютно уверены в том, что крестьянин придет покормить вас – во всяком случае, вы можете так полагать. Но вы не знаете, что на следующий день приходится День благодарения. Именно тогда, когда вероятность оказаться накормленным становится выше, чем когда-либо прежде, вас обрекают на убой. Ошибочное представление о том, что риск может быть рассчитан (например, по формуле Лапласа), не что иное, как иллюзия индюка.

Между неожиданным бедствием, свалившимся на индюка, и неспособностью экспертов предвидеть финансовые кризисы можно увидеть определенное сходство. В обоих случаях используются модели, которые работают лишь в краткосрочной перспективе и не способны предвидеть катастрофы, которые надвигаются издалека. Как и в случае с индюком, оценки рисков на рынке жилья США основывались на исторических данных и на моделях, подобных по своей сути правилу следования. Так как цены на жилье продолжали расти, то всем казалось, что риск становится меньше. Уверенность в стабильности достигла своего максимума именно перед началом кризиса. Проблема заключается в ненадлежащих методиках оценки риска, которые ошибочно допускают известные риски в мире неопределенности. Так как эти расчеты дают точные числовые значения неопределенного риска, то они порождают иллюзорную определенность.

Широко распространено мнение о том, что простые практические правила являются «быстрыми и грубыми» упрощениями. Они экономят время и силы, но цена такой экономии – снижение качества. Эта идея получила название компромисс между точностью и усилиями. При принятии решений, утверждают сторонники этой идеи, простые практические правила всегда оказываются вторыми наилучшими. Однако это справедливо лишь в мире известных рисков, а не в неопределенном мире. Чтобы принимать хорошие решения в неопределенном мире, необходимо игнорировать часть информации – что и делают простые практические правила. Это позволяет экономить время и силы и принимать лучшие решения.

Глава 3. Оборонительная позиция при принятии решений

Я применяю термин «культура ошибок» к культуре, в которой можно открыто признавать ошибки, чтобы учиться на них и избегать их в будущем.

Гештальт-психологи и их последователи для демонстрации работы нашего восприятия используют зрительные иллюзии. Когда мы смотрим вокруг, мы думаем, что воспринимаем внешний мир. Но это не так. Наш мозг – это не зеркало. Той информации, что к нему поступает, недостаточно, чтобы зеркально отражать мир. Например, мир трехмерен, но его изображение на сетчатке глаза всего лишь двумерно.

В результате мы не можем непосредственно воспринимать расстояния и поэтому должны делать догадки, основанные на неопределенных подсказках, которые дают нам освещение, тени и перспектива. Великий философ Герман ван Гельмгольц назвал эти догадки «бессознательными умозаключениями». Без этих умных догадок мы действовали бы менее удачно. Но наш разум позволяет нам не ограничиваться имеющейся информацией и принимать на себя риски.

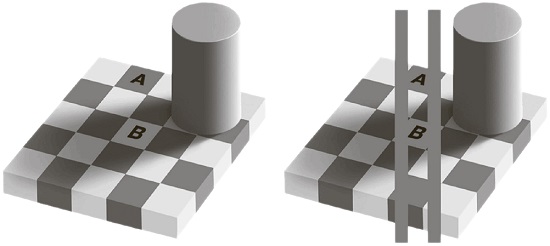

Посмотрите на шахматную доску, представленную слева на рис. 4. Она состоит из черных и белых квадратов. Так, квадрат, помеченный буквой А, выглядит черным, а квадрат, помеченный буквой В, – белым. Однако в действительности квадраты А и В закрашены одним и тем же оттенком серого. В это трудно поверить, потому что наши глаза видят их окрашенными в два разных цвета. Наш мозг не просто оценивает свет, отраженный от каждого квадрата, он использует соседние квадраты для того, чтобы делать умные выводы. Чтобы убедиться, взгляните на шахматную доску в правой части рисунка, где два квадрата соединены двумя вертикальными полосками одного и того же оттенка серого. Это позволит вам понять, что оба квадрата окрашены в одинаковый цвет.

Рис. 4. Иллюзия восприятия цвета клеток шахматной доски

Какая невероятная ошибка! Но задумайтесь на минутку. Если бы наш мозг не совершал такую «ошибку», то мы видели бы много разных оттенков серого, а не шахматную доску с черными и белыми квадратами. Но вместо того, чтобы просто оценить свет, отраженный от каждого квадрата, независимо от всех остальных, наш мозг использует контекстную информацию, чтобы мы могли сделать вывод о том, что мы видим. Зрительные иллюзии – это не грубые ошибки, а побочные продукты умной системы (подробнее см. Марк Чангизи. Революция в зрении: что, как и почему мы видим).

Открытие чего-то такого, чего не собирались обнаруживать, часто оказывается продуктом ошибки. Христофор Колумб хотел найти морской путь в Индию. Он верил, что сможет доплыть до Индии на корабле, потому что допустил ошибку. Он сильно недооценил диаметр земного шара. Другие знали, что он ошибается, и критиковали его план. Они были правы. Но благодаря своей ошибке Колумб открыл нечто другое – Америку. И точно так же некоторые мои открытия тоже никогда не планировались, например, открытие эффекта «меньше – значит больше». Вот его история.

Для одного эксперимента нам потребовались два списка вопросов: простых и сложных. Так как участниками эксперимента были немцы, то мы решили подготовить вопросы о населении городов Германии (которые, как мы полагали, окажутся легкими) и о населении городов США (их мы считали трудными). Мы выбрали по 75 крупнейших городов в каждой стране. Наши вопросы звучали, например, так: «Численность населения какого из городов больше – Детройта или Милуоки?», «Численность населения какого из городов больше: Билефельда или Ганновера?»

Нас поразили полученные результаты. Ответы немцев на вопросы о городах Германии, о которых они знали много, отнюдь не были более правильными, Более того, они даже немного лучше отвечали на вопросы о городах США, о которых они знали гораздо меньше. Мы совершили ошибку, решив, что знать больше – это значит всегда делать более правильные заключения. Эксперимент оказался неудачным. Но эта ошибка привела нас к открытию чего-то нового, что мы назвали эвристикой узнавания – если вы узнаете название одного города, но не знаете название другого, то население города, название которого вы знаете, больше.

Полезные ошибки помогают нам учиться и делать открытия. Система, которая не делает ошибок, будет меньше обучаться и еще меньше открывать что-то новое.

Профессии, компании и группы лиц имеют свои культуры ошибок. На одном краю спектра находятся негативные культуры ошибок. Люди в таких культурах боятся совершать любые ошибки, независимо от того, полезные они или вредные, и, если ошибка все же случается, они делают все, чтобы ее скрыть. В таких культурах имеется мало шансов на то, что человек будет учиться на ошибках и открывать новые возможности (например, врачи). На другом краю спектра находятся позитивные культуры ошибок, которые не скрывают допущенные ошибки, поощряют полезные ошибки и учатся на вредных ошибках, чтобы создавать более безопасную среду (например, пилоты).

Заседания многих комиссий заканчиваются словами: «Нам нужно больше данных». Все радостно кивают головами и издают вздох облегчения, довольные тем, что принятие решения откладывается. Виновата в этом негативная культура ошибок: в такой культуре никому не хватает смелости принять решение, за которое он может понести наказание.

Оборонительная позиция при принятии решений заключается в следующем: человек или группа людей оценивают вариант А как наилучший в данной ситуации, но выбирают более плохой вариант В, чтобы защитить себя на тот случай, если что-то пойдет не так, как надо.

Оборонительная медицинская практика: врач назначает клинически не обоснованные исследования или лечение, которые могут даже нанести вред здоровью пациента, опасаясь возможных судебных преследований.

Спрашивайте ваших врачей, что они выбрали бы для себя, а не что они рекомендуют вам.

Глава 4. Почему мы боимся того, что для нас практически не представляет опасности?

Почему мы боимся, что на нас могут напасть акулы, но даже ни на минуту не задумываемся о том, что по дороге на пляж можно погибнуть в автомобильной аварии? Моя гипотеза заключается в следующем: в тех ситуациях в человеческой истории, в которых совершение ошибок было смертельно опасным, мы выработали у себя склонность избегать необходимости учиться на собственном опыте. Вместо этого мы предпочитаем полагаться на социальное знание того, чего следует бояться. Вот два способа, которые позволяют нам научиться опасаться определенных объектов без получения непосредственного опыта их восприятия. Это социальное подражание и биологическая подготовленность.

Бойся всего, чего боится твоя социальная группа.

Странные для нас страхи, которым подвержены представители других культур, стали темой историй, рассказанных путешественниками. В Европе любят украшать рождественские елки восковыми свечами, в США – электрическими. В XIX веке одним из самых страшных кошмаров – оказаться погребенным заживо (плохо диагностировали смерть). В салонах самолетов американских авиакомпаний нет кресел под номером 13. А в Азии во многих отелях нет четвертого этажа: число 4 считается несчастливым в китайской культуре, так как его произношение созвучно слову «смерть». В Европе опасаются генетически модифицированных продуктов, а в США к ним относятся спокойно.

Изучая отношение людей к риску, их иногда разделяют на две группы: на тех, кто ищет риск, и на тех, кто его избегает. Но было бы неправильно относить каждого индивида только к одной или только к другой категории. Кто-то один, избегающий риска потребления генетически модифицированной кукурузы, может быть заядлым курильщиком, а кто-то другой, кто боится пожара и не зажигает восковые свечи на рождественской елке, может охотно брать на себя риск хранения дома огнестрельного оружия.

Эволюция снабдила нас вторым принципом осознания опасности, который представляет собой хитроумное сочетание влияний природы и воспитания. Объект страха генетически «подготовлен», но для того, чтобы активировать страх, требуется вводная социальная информация.

Многие фобии, легко приобретаемые людьми, представляют собой биологически подготовленные ассоциации. К ним относятся страхи перед животными (пауками, рептилиями), страхи перед объектами или событиями (ничем не ограниченным пространством, громом) и страх перед другими людьми (угрожающими лицами, возможностью социального отвержения).

Часть II. Как научиться осознавать риск

Глава 5. Помните о своих деньгах

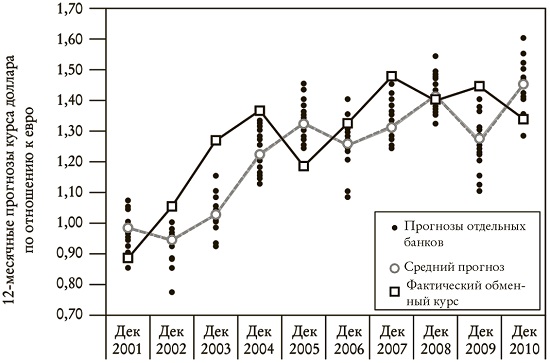

Мир инвестиций отличается высокой неопределенностью, и использование финансовых теорий, разработанных для мира известного риска, может породить иллюзию индюка. На рис. 5 отражены прогнозы, которые делали в конце года 22 международных банка на протяжении 10 лет.

Рис. 5. Прогнозируемые и реальные соотношения курса доллара к евро

Эти прогнозы делали не любители, а высокооплачиваемые финансовые аналитики, использовавшие сложные математические модели. Например, у JPMorgan Chase, крупнейшего американского банка по суммарной стоимости активов, ошибка в оценке обменного курса составляла в среднем 30 центов. Все эти эксперты думали одно и то же: следующий год будет похож на нынешний. На протяжении десяти лет они из года в год постоянно предсказывали сохранение прошлогоднего тренда роста или снижения. Более чем в 90 % прогнозов эксперты следовали именно этому правилу. Вы также могли бы это делать. Единственная проблема заключается в самом курсе доллара по отношению к евро, который не следует этой логике. А это означает, что каждое изменение тенденции не будет учитываться в прогнозах.

Куда идет рынок акций? Профессиональные прогнозисты, опрошенные Bloomberg.com, ожидали, что 2008 г. будет успешным, и средний прогноз предполагал рост рынка на 11%. Никто не ожидал, что начнется спад. Однако к концу года индекс Standard&Poor снизился на 38%.

Общий вывод заключается в том, что банковские аналитики недооценивают волатильность рынка акций и обменного курса. Виноваты в этом математические модели, которые они используют. В этих моделях крайне непредсказуемый финансовый рынок представляется таким, как будто его риски предсказуемы. Как следствие, прогнозы неизменно не предвидят значительных подъемов и спадов и оказываются относительно точными, только если на рынке не происходит ничего серьезного – то есть в тех случаях, когда сохраняется прошлогодняя тенденция.

Предположим, вы хотите инвестировать. Вы не желаете класть все яйца в одну корзину и рассматриваете акции разных компаний. Вы хотите диверсифицировать инвестиции. Но как это лучше сделать? Гарри Марковиц получил Нобелевскую премию по экономике за решение этой задачи. Его решение получило название портфеля со средним отклонением. Портфель максимизирует доход (среднее) для данного риска или минимизирует риск (дисперсию) для данной доходности. Я советую – распределяйте ваши деньги поровну между N фондами. Анализ показал, что это простое правило (1/N) работает лучше.

Существует математическая теория, объясняющая нам, почему и когда простое правило оказывается лучше. Оно называется дилеммой смещения и дисперсии. Суть теории выражена в идее, приписываемой Альберту Эйнштейну: «Все должно быть сделано настолько простым, насколько это возможно, но не проще».

То, насколько допустимо упрощение, зависит от трех факторов. Во‑первых, чем выше неопределенность, тем больше мы должны стремиться к ее упрощению. Чем меньше неопределенность, тем более сложной она может быть. Рынок акций отличается высокой неопределенностью в том смысле, что он крайне непредсказуем. Это говорит в пользу таких простых методов, как 1/N. Во-вторых, чем больше имеется альтернатив, тем больше мы должны их упрощать, чем их меньше, тем более сложными они могут быть. В-третьих, чем больше имеется прошлых данных, тем это выгоднее для сложных методов.

Различие между предсказанным и истинным результатом называется смещением. В отличие от метода 1/N сложные методы используют наблюдения, полученные в прошлом, для предсказания будущего. Эти предсказания будут зависеть от конкретной выборки наблюдений и, следовательно, могут быть нестабильными. Эта неустойчивость (разброс этих предсказаний вокруг их среднего значения) называется дисперсией.

Глава 6. Лидерство и интуиция

Интуиция, или «внутреннее чутье», позволяет получить суждение: 1) которое быстро возникает у нас в голове, 2) основополагающие мотивы которого мы не осознаем в полной мере, 3) настолько сильное, что мы можем предпринять на его основе какие-то действия. Воспринимать интуицию серьезно – значит уважать тот факт, что она является разновидностью знания, которое человек не может выразить словами. Если у человека с большим опытом возникает плохое предчувствие, не спрашивайте у него, чем оно вызвано (см. также Майкл Полани. Личностное знание).

Несмотря на то что интуитивные решения в бизнесе принимаются довольно часто, в университетах будущим менеджерам не рассказывают об интуиции практически ничего. Напротив, большинство из них обучают тому, что существует только один рациональный способ принятия решений, а именно старая добрая теория принятия решений. Эта теория требует от них делать невозможное: определять все имеющиеся альтернативы, все их результаты, умножать полезность каждого результата на его вероятность и выбирать альтернативу с наивысшей ожидаемой полезностью. Проблема заключается в том, что реальный мир бизнеса не живет по таким законам.

Правила, применяемые руководителями высшего уровня для развития своих предприятий:

- Нанимать хороших специалистов и позволять им делать свою работу.

- Осуществлять децентрализацию операций, децентрализацию стратегии.

- Продвигать наверх собственные кадры.

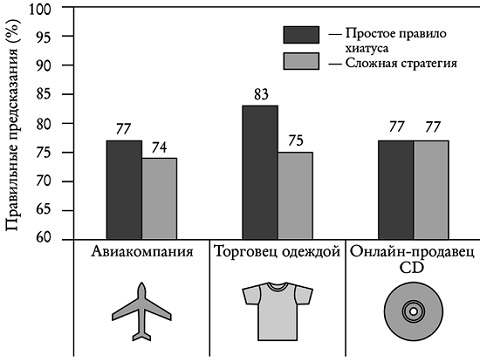

Как можно отделить активных покупателей от неактивных в базе данных, содержащей десятки или сотни тысяч имен? Традиционный подход заключается в решении сложной задачи посредством сложного анализа. Одним из таких инструментов является модель Pareto/NBD, используемая экспертами по маркетингу. Менеджеры одной крупной международной авиакомпании полагались на правило «свежести» последней покупки – правило хиатуса (в данном случае: перерыв, пробел): если клиент не делал покупок в течение девяти месяцев или больше, его классифицируют как неактивного, в противном случае – как активного.

Правило хиатуса основывается на том, что люди принимают решения иррационально, так как они имеют ограниченные когнитивные способности и не могут обрабатывать всю информацию, необходимую для принятия хорошего решения. Два профессора в сфере бизнеса провели исследование, призванное продемонстрировать превосходство сложного метода над простым правилом (рис. 6). Однако, авторы обнаружили то, что я называю эффектом меньше значит больше.

Рис. 6. Проверка утверждения «меньше значит больше»

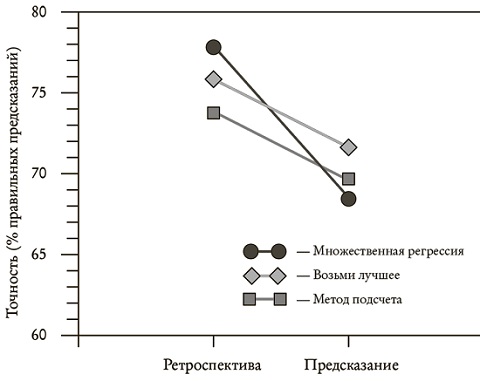

На рис. 7 приведены средние результаты, полученные в ходе 20 исследований, в которых сравнивались значения, полученные в случае применения двух простых правил и сложной стратегии, получившей название «множественная регрессия» (подробнее см. Введение в множественную регрессию). При ее применении требуется тщательно оценивать важность каждого параметра. Одно из проверявшихся простых правил, называемое методом подсчета, полагается на все сигналы, но придает им одинаковое значение. Второй метод, известный под названием «возьми лучшее», полагается только на один самый важный параметр и игнорирует все прочие.

Рис. 7. Иллюстрация применения простых правил и сложного метода для предсказаний

Известные риски имеют отношение к прошлому. Мы знаем все детали (такие, как цифры прошлогодних продаж) и можем объяснить их постфактум. Для «предсказания» прошлого сложная стратегия в этих исследованиях обеспечивала наилучшие результаты. Однако, когда дело касалось неопределенного будущего, то оба простых правила давали более точные предсказания, чем сложный метод.

Что характеризует лидера? В последнее время модным стало утверждение о том, что способность к лидерству – это не просто сумма, а особое сочетание каких-то характеристик. Другой способ выбора хороших лидеров заключается в отказе от поиска лидерских качеств и в выявлении тех людей, которые способны умело использовать простые практические правила. Истинное лидерство означает интуитивное понимание того, какое правило будет работать в той или иной ситуации.

Глава 12. Революционное преобразование школы

В соответствии с моими представлениями курс обучения рисковой грамотности должен включать три направления:

- Медицинская грамотность.

- Финансовая грамотность.

- Умение выразить/оценить риск в цифрах.

Для освоения каждой темы необходимы:

- Статистическое мышление.

- Умение применять простые практические правила.

- Знание психологии риска.

В системе, в которой основной акцент делается на тестировании, существуют способы избежать того, чтобы ученики учились только ради сдачи тестов, а затем выбрасывали из головы все, чему их учили. Вот один из них: не проводить проверку знаний только по теме занятий последнего месяца; включать в тесты то, что изучалось раньше и что еще вообще не изучалось.

Цифровая революция открыла новые возможности, позволяя одновременно выполнять сразу несколько задач. Подростки читают e-mail, пишут текстовые сообщения и слушают любимую музыку, выполняя домашние задания. Но базовый психологический принцип гласит: мы можем сосредотачивать наше сознательное внимание только на одной задаче. Успешно выполнять сразу несколько задач можно, если все задания, кроме одного, выполняются подсознательно. По утверждению английского философа Альфреда Торта Уайтхеда, «цивилизация развивается благодаря увеличению числа операций, которые мы можем выполнять, не думая о них».

Библиография на русском языке

Акерлоф Джордж А., Шиллер Роберт Дж. Spiritus Аnimalis, или Как человеческая психология управляет экономикой. – М.: Юнайтед Пресс, 2010 – 280 с.

Ариели Дэн. Предсказуемая иррациональность. Скрытые силы, определяющие наши решения. – М.: Манн, Иванов и Фербер, 2010. – 296 с.

Беккер Гэри С. Человеческое поведение. Экономический подход. – М.: Издательство ГУ ВШЭ, 2003. – 672 с.

Берлин Исайя. Две концепции свободы // В сб. Исайя Берлин. Философия свободы. Европа. – М.: Новое литературное обозрение, 2014. — 448 с.

Канеман Дэниэль. Думай медленно… решай быстро. – М.: АСТ, 2013. – 656 с.

Льюис Майкл. Игра на понижение. Тайные пружины финансовой катастрофы. – М.: Альпина Паблишер, 2016. – 280 с.

Найт Фрэнк Хейнеман. Риск, неопределенность и прибыль. – М.: Дело, 2003. – 360 с.

Нисбетт Ричард. Что такое интеллект и как его развивать. Роль образования и традиций. – М.: Альпина нон-фикшн, 2017. – 344 с.

Талеб Нассим. Одураченные случайностью. Скрытая роль шанса в бизнесе и обществе. – М.: Манн, Иванов и Фербер, 2011. – 320 с.

Талеб Нассим. Черный лебедь. Под знаком непредсказуемости. М.: КоЛибри, 2009. – 528 с.

Талер Ричард. Новая поведенческая экономика. Почему люди нарушают правила традиционной экономики и как на этом заработать. – М.: Эксмо, 2017. – 368 с.

Хафф Дарелл. Как лгать при помощи статистики — М.: Альпина Паблишер, 2015. – 168 с.

[1] Научный журнал Nature освещал споры между теми, кто считал, что люди не способны по своей сути иметь дело с рисками, и теми, кто смотрел на них более позитивно. Замечу, что к числу последних отношусь и я. Представитель лагеря пессимистов экономист Ричард Талер утверждал, что «мысленные иллюзии следует считать скорее правилом, чем исключением», а его соратник, когнитивный психолог Массимо Пьяпелли Пальмерини, доказывал, что «наш биологический вид абсолютно не способен к пониманию вероятностей». Эволюционный биолог Стивен Джей Гулд утверждал, что «наш разум не создан (по многим причинам) для работы с правилами вероятности», а экономист Дэн Ариели (см. Поведенческая экономика) – что «мы не только иррациональны, но предсказуемо иррациональны, то есть наша иррациональность проявляется одним и тем же способом, снова и снова». Психолог Дэниел Канеман пошел еще дальше и приписал возникновение наших мысленных иллюзий старой биологической «Системе I», которая «нелегко поддается обучению». Я не согласен с такими пессимистичными воззрениями. Когнитивные иллюзии не заложены в нас природой. Существуют простые инструменты, позволяющие иметь дело с рисками и неопределенностью, которые может быстро освоить каждый.

Старомодный «жесткий» патернализм предполагает, что люди эгоистичны и нуждаются в руководстве для того, чтобы вести себя в интересах общества, в частности, соблюдать законы и платить налоги. В книге Nudge. Архитектура выбора Талер предложили версию «мягкого» патернализма, который слегка «подталкивает» людей к принятию решений в их собственных интересах. Хотя мягкий патернализм не предполагает использование силы, он более радикален, чем жесткий патернализм, поскольку предполагает, что люди даже не знают, в чем заключаются их интересы. Новый аргумент заключается в том, что поскольку люди имеют систематические когнитивные иллюзии, то патернализм необходим для изменения их поведения. Но этот аргумент нельзя признать правильным. Когнитивные искажения не подразумевают патернализма.

[2] Позвольте мне сразу исправить одно распространенное ошибочное представление об эвристике. В соответствии с концепцией эвристики и искажений (Даниэль Канеман. Думай медленно… решай быстро) наше мышление может быть представлено с помощью двух систем, обладающих противоположными характеристиками. Подсознательная Система 1 использует эвристики и совершает ошибки. Сознательная Система 2, напротив, действует, руководствуясь логическими и статистическими правилами и, по-видимому, ошибок не делает. Но такая картина противоречит реальным фактам. Во-первых, каждая рассмотренная нами эвристика может использоваться и подсознательно, и сознательно; таким образом, эвристика не находится в оппозиции сознанию. Во-вторых, эвристики не являются источником ошибок и могут приводить к более точным выводам, чем логические или статистические методы. Следовательно, эвристики и ошибки не связаны между собой. Концепция двух систем упускает из виду различие между риском и неопределенностью. Статистические методы требуются для работы с известными рисками, а эвристики – в условиях неопределенности. Вместо того чтобы тратить время на критику эвристик, нам нужно изучать их экологическую рациональность, то есть выяснять, когда они работают, а когда нет.

В то же время простые практические правила всегда имеют позитивное значение в тех областях, где мы имеем дело с неопределенностью, например, при создании искусственного интеллекта и изучении поведения животных. Изначально греческое слово «эвристика» означало «выживание для нахождения или обнаружения чего-либо». Математик Г. Поля из Стэнфордского университета указал в 1954 г. на различие между эвристическим и аналитическим мышлением. Например, эвристическое мышление необходимо для нахождения математического доказательства, а аналитическое мышление – для проверки этого доказательства на всех его этапах. Поля познакомил с эвристиками Герберта Саймона (о последнем см. Герберт Саймон. Науки об искусственном).

[3] Первым на различие между риском и неопределенностью указал экономист Чикагского университета Фрэнк Найт (Фрэнк Хейнеман Найт. Риск, неопределенность и прибыль). Некоторые ученые не признают различие между риском и неопределенностью на том основании, что всегда можно сформировать условные вероятности, позволяющие свести неопределенность к риску. Я не считаю такой взгляд плодотворным, как и Джимми Саваж, отец современной байесовской теории решений, которому часто приписывается этот редукционистский подход. Саваж ограничил применение своей теории «малыми мирами», то есть четко определенными задачами, в которых все известно, такими как лотереи. Но он считал, что было бы «просто смешно» применять его теорию к большим мирам, даже к таким простым задачам, как планирование семейного пикника или подготовка к партии в шахматы. Лично я рассматриваю разум как набор адаптивных инструментов, который включает в себя простые практические правила и правило Байеса, причем каждый такой инструмент должен использоваться в своих целях. Хотя часто нам хочется рассматривать каждую задачу как задачу о вероятностях, такой подход подобен использованию исключительно молотка для выполнения всех ремонтных работ в доме.

[4] Иногда говорят, что для Канемана стакан рациональности наполовину пуст, а для Гигеренцера он наполовину полон. Один пессимист, а другой оптимист. Такие характеристики упускают из виду главное. Мы различаемся в первую очередь в понимании того, что представляет собой стакан рациональности. Канеман и его последователи рассматривают логику и теорию вероятности как общую, «не видящую содержания», норму рациональности. По их мнению, эвристика никогда не может быть более точной, а может быть лишь более быстрой. Однако это справедливо лишь в мире известного риска. В мире неопределенности простая эвристика часто может работать лучше. Реальный вопрос для исследователей заключается в понимании того, когда и почему это происходит. Ответы, которые мы знаем сегодня, основываются на дилемме смещения дисперсии и общих исследованиях экологической рациональности.

Сергей Викторович, добрый день.

Спасибо за ваши конспекты!

Конкретно в этом исправьте пожалуйста опечатку:

«Анализ показал, что это простоя правило (1/N) работает лучше.»

Спасибо. Поправил.

Добрый день!

Спасибо, за Ваш труд! Периодически яндекс приглашает зайти в гости на Ваш сайт)

Комментарий по тексту, похожев отрывке ниже пропущен первый фактор:

«То, насколько допустимо упрощение, зависит от трех факторов. Во-вторых, чем больше имеется альтернатив, тем больше мы должны их упрощать, чем их меньше, тем более сложными они могут быть. В-третьих, чем больше имеется прошлых данных, тем это выгоднее для сложных методов.»

Василий, спасибо. Поправил.

Спасибо большое за ваш труд. Очень ценные знания!